Update24.3.23: Ein bisschen was zum Nachdenken für die Querdenker, die hier in ihren Kommentaren herumpöbeln (die außer im Archiv für die Staatsanwaltschaft ohnehin nirgends zu sehen sein werden) und allen Ernstes von „Hetze“ gegen den Impfgegner und Verschwörungspropagandisten Arvay fabulieren, weil ein paar wissenschaftsinteressierte und -kompetente Bürger ihre Freizeit aufgewendet haben, um aufzuklären über die lebensgefährliche Desinformation, die Arvay über Covid, Impfungen und andere Schutzmaßnahmen verbreitet hat, über seine Verschwörungsideologie und seine Verbindungen zur rechten Szene. Seht es Euch an und überlegt einfach mal, ob Ihr wirklich zu diesen Leuten gehören wollt:

Update 18.2.21: Da ich keine Lust habe, noch mehr meiner Lebenszeit auf diesen Menschen zu verschwenden und in diesem Volksverpetzer-Artikel auch alles über Arvays Desinformation zu MaiLab gesagt ist, empfehle ich aktuell einfach mal, den zu lesen:

https://www.volksverpetzer.de/corona-faktencheck/cgarvay-mailabder/

Einzige, aber wichtige Korrektur dazu; der Volksverpetzer schreibt: „Er behauptet aber auch veraltete Sachen, so z.B: dass „die Impfstoffe“ (er formuliert das ständig so pauschal, ohne konkret zu sagen, welchen Impfstoff er eigentlich meint) nicht in der Lage seien, die Infektiosität zu senken, was laut aktuellen Studien noch gar nicht abschließend beurteilt werden kann.“

Abschließend vielleicht nicht, aber bei halbwegs vernünftiger Interpretation der verfügbaren Datenlage ist vollkommen offensichtlich, dass die Covid-Impfstoffe, bei denen dazu etwas untersucht wurde (von Pfizer und AZ) die Wahrscheinlichkeit einer Weitergabe ganz erheblich reduzieren. Was Arvay da verbreitet, ist also mal wieder nicht bloß veraltet, sondern einfach vollkommen falsch, und da er ja offenbar wenigstens ab und zu in Forschungsdaten reinschaut, frage ich mich schon, wie das sein kann, dass er das nicht auch selbst weiß.

Insofern freue ich mich auch schon auf den kommenden Artikel über ihn im lesenswerten Rechercheportal MedWatch, den Arvay freundlicherweise schon selbst angekündigt hat. Dann muss ich hoffentlich wirklich nicht nochmal selbst etwas über ihn schreiben.

Nach dem Politfossil mit ferner Vergangenheit im Gesundheitsamt, Wolfgang Wodarg, dem lange in Pension gegangenen Bakterien- und (zu dem Thema schon damals umstrittenen) Atheroskleroseforscher, der jetzt gerne so tut als wäre er Virologe, Sukharit Bhakdi (Update 5.10.20: Ulf J. Froitzheim hat Bhakdi und seinem seltsamen Netzwerk von Verschwörungsgläubigen inzwischen ausführlicher nachrecherchiert, Teil 2, vergisst aber zu erwähnen, dass Bhakdi in seiner lange zurückliegenden Zeit in der Wissenschaft kaum etwas zu Viren und gar nicht zu Corona-, Grippe oder Erkältungsviren, sondern fast nur nur zu Bakterien und Atherosklerose publiziert hat. Interessant ist auch der hier zusammengefasste Faktencheck zu Bhakdis Buch in der Süddeutschen Zeitung.), und dem Schwindeldoktor Bodo Schiffmann rückt in der Szene der Verschwörungsgläubigen gerade ein neuer Pseudoexperte in die erste Reihe: Der österreichische Autor Clemens Arvay. Anhänger des bizarren, antisemitischen QAnon-Verschwörungskults präsentieren Arvay ebenso als Experten für Covid-19 und für Impfstoffe wie der russische Propagandakanal RT Deutsch. Dass in derselben Videoreihe von RT Deutsch wie Arvay inzwischen auch mein alter Bekannter und früherer Skeptikerkollege Mark Benecke aufgetreten ist, finde ich… naja, sagen wir bedauerlich, aber das ist ein anderes Thema.

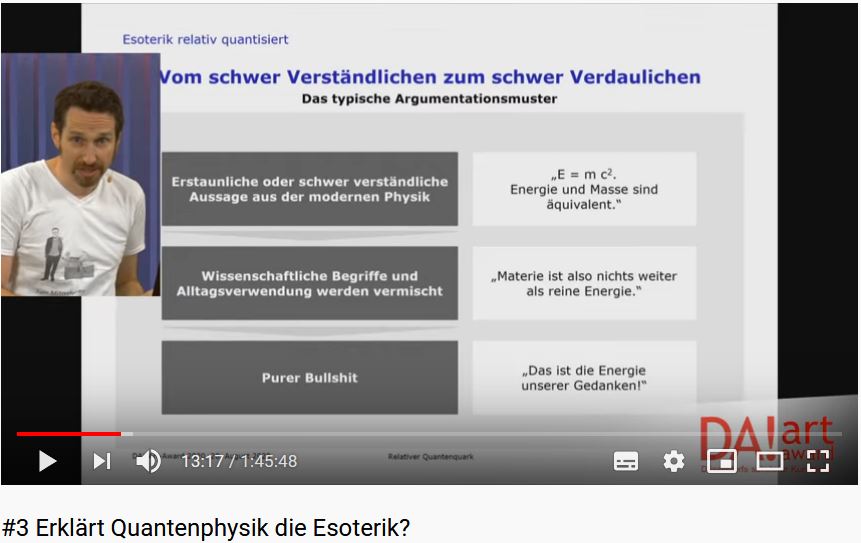

Damit sind wir dann mal wieder mitten im Covid-19-Thema und weit weg von den Quanten – und irgendwie muss ich sagen, dass ich mich ein bisschen nach der vergleichsweisen Harmlosigkeit der Quantenschwurbler zurücksehne. Aber nachdem ich mir das Impfthema ja jetzt schon mehrfach vorgenommen habe, was soll’s, es ist eben aktuell das Wichtige. Also, in for a penny, in for a pound!

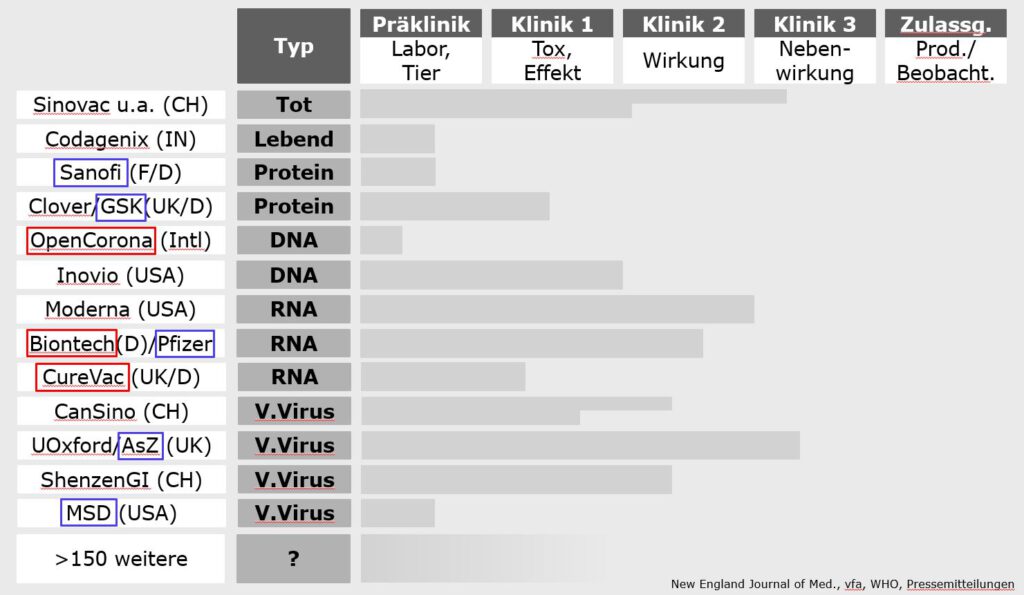

Im Frühjahr hat Arvay noch hauptsächlich gegen den Mund-Nasen-Schutz agitiert; heute spielt er für die Verschwörungsmythenszene vor allem den Kronzeugen gegen RNA-Impfstoffe. Was es mit RNA-Impfstoffen und anderen modernen Impfstoffkonzepten auf sich hat, habe ich Anfang August in einem längeren Artikel erklärt, den ich noch für eine Weile versuchen werde, halbwegs aktuell zu halten. Was ist aber nun von Arvay und seiner Argumentation zu halten?

Update 23.9.2020: Um es gleich mal vorwegzuschicken, Arvay selbst hat in einem ziemlich ausführlichen Video auf diesen Artikel reagiert. Ein paar Punkte darin sind inhaltlich diskussionsfähig, andere sind eher ein Herausreden – kann man sich ansehen, wenn man viel Zeit hat.

Update 27.9.2020: Am 26. hat er noch ein weiteres Video online gestellt, in dem er sich jetzt ganz offen als Verschwörungsgläubiger outet: „Corona ist ein großer Aufzeiger, wie unsere Gesellschaft unterwandert ist.“ Dazu kreiert er eine bizarre Verschwörungsgeschichte um sich selbst, nach der er im Auftrag der Pharmaindustrie von Wikipedia, dem Genetikprofessor im Ruhestand Wolfgang Nellen (der nach seriösen wissenschaftlichen Publikationen von Arvay gesucht und wenig gefunden hat) und natürlich von mir verfolgt wird. Dabei hat er immerhin meine Firmenwebsite gefunden (Kunststück, die ist oben unter „Der Autor“ verlinkt), war aber offensichtlich nicht in der Lage zu erkennen, dass es sich um eine Strategieberatung und nicht, wie er sich einbildet, um eine PR-Agentur handelt. Ich kenne ja einige Pharmaunternehmen ganz gut, und ohne mich jemals mit deren PR-Abteilungen beschäftigt zu haben, kann ich mir beim besten Willen nicht vorstellen, dass jemand, der auf Youtube Pseudowissenschaft verbreitet, denen etwas anderes als vollkommen egal ist. Arvays gesellschaftliche Relevanz liegt ausschließlich darin, dass er Stichwortgeber für antidemokratische Gruppierungen ist. Dass es Menschen gibt, die sich einfach so in ihrer Freizeit für Demokratie und Wissenschaft engagieren, ist für Arvay offensichtlich vollkommen unvorstellbar, was vielleicht auch einiges über ihn aussagt. Im Video beruft sich Arvay beim Versuch, sich als seriösen Wissenschaftler auszugeben, mehrfach auf den Psychiater Raphael Bonelli, der mit seinem erzkatholischen RPP-Institut in Österreich als aggressiver Covid-Verharmloser in Erscheinung tritt, trotz Fallzahlen in Österreich, die zum Zeitpunkt (Update 23.10.20) doppelt so hoch waren wie in Deutschland, Social Distancing als „extrem schädlich für die Menschen“ bezeichnet hat, früher „Psychiatrie am Telefon“ auf Radio Maria angeboten und auch schon einen „Homo-Heiler“ zu einem seiner Kongresse eingeladen hat. Beim Versuch, sich zu rechtfertigen, demontiert Arvay ganz nebenbei noch seine ohnehin bescheidene eigene wissenschaftliche Reputation – und die seiner früheren Hochschule gleich mit. Das Video ist also echt sehenswert.

Vorgestellt wird er bei seinen Absonderungen zu RNA-Impfstoffen als „Biologe“, was offenbar Sachkompetenz vorspiegeln soll – schließlich könnte ein Human- oder Molekularbiologe tatsächlich zum menschlichen Immunsystem oder zu Impfstoffen geforscht haben. Hat er aber nicht. Arvay ist Diplomingenieur in „Angewandten Pflanzenwissenschaften“ von der Universität für Bodenkultur Wien (Update 23.9.20: Bemerkung über die Universität für Bodenkultur entfernt). Update 27.9.20: Inzwischen hat Arvay in einem Video selbst erklärt, dass er seine offenbar einzige ernstzunehmende Leistung an einer wissenschaftlichen Institution überhaupt, nämlich seine Masterarbeit, am dortigen Institut für Gartenbau abgelegt hat – und zwar über die Soziologie von Selbstversorgern. Über einen Abschluss in Biologie verfügt er nicht. Eine Doktorarbeit, in der er überhaupt in relevantem Umfang geforscht haben könnte, hat er nicht gemacht. Nun gehöre ich ja nicht zu den Leuten, die meinen, dass eine Promotion der erste Schritt zur Menschwerdung sei. Die meisten Menschen, die promoviert haben, einschließlich mir, brauchen das für ihre tägliche Arbeit überhaupt nicht, aber in Arvays Fall ist das tatsächlich relevant: Seinen Versuchen, wissenschaftlich klingende Artikel zu verfassen, ist nämlich deutlich anzumerken, dass er wissenschaftliches Arbeiten schlicht nie gelernt hat.

Arvay ist also nicht vom Fach was Impfungen angeht. Nun habe ich schon bei meinem letzten Artikel zum Thema klargestellt, mein Fachgebiet ist das auch nicht. Ich kann, weil ich eben wissenschaftliches Arbeiten gelernt habe, den wissenschaftlichen Konsens in einem fremden Fachgebiet wiedergeben und erklären – das ist es aber auch. Ich würde mir nicht anmaßen, denen, die in einem Fachgebiet forschen oder denen, die beruflich deren Ergebnisse zusammenfassen (bei Impfstoffen zum Beispiel dem Paul-Ehrlich-Institut) zu erzählen, wie sie ihre Arbeit zu machen haben. Deswegen bemühe ich mich zum Beispiel auch, vorsichtig mit Äußerungen zum „Insektensterben“ zu sein, obwohl mir (mit meinem Hintergrund in einer experimentell arbeitenden Naturwissenschaft) beim Design der Studien, die dieses Sterben belegen sollen, die Haare zu Berge stehen. Das ist etwas vollkommen anderes, wenn ein pseudowissenschaftliches Glaubenssystem wie die Homöopathie „wissenschaftliche“ Studien verbreitet, die nicht den Standards im eigenen Fachgebiet (also der evidenzbasierten Medizin) entsprechen und zur Begründung Behauptungen aufstellt, die fundamentalen Erkenntnissen experimentell wesentlich zuverlässigerer Naturwissenschaften widersprechen.

Arvays Verkaufsargument ist „Ökologie“. Was er darunter versteht ist allerdings eher eine Art mystisch aufgeladene Naturromantik mit steilen Thesen zum Beispiel über gesundheitliche Effekte des Betrachtens von Bäumen, die er um immer dieselben aus dem Zusammenhang gerissenen Aussagen aus immer derselben Handvoll fragwürdiger Studien herum ausschmückt.

Seine vermeintliche Glaubwürdigkeit zu Impfstoffen gründet sich darauf, dass es ihm irgendwie gelungen ist, im Juli einen Artikel über „Genetische Impfstoffe gegen COVID-19“ in der Schweizerischen Ärztezeitung (SÄZ) unterzubringen. Einen ähnlichen Coup mit der Fachzeitschrift eines Berufsverbandes hatte er schon 2018, als er es geschafft hat, einen esoterischen Artikel über die angebliche Heilkraft des Waldes der Deutschen Apothekerzeitung (DAZ) unterzujubeln. Eine wissenschaftliche Begutachtung der Artikel (peer review) gibt es bei beiden Blättern nicht, sondern „Die Redaktion prüft eingereichte Beiträge nach den Kriterien der Qualität, Originalität und Aktualität“, wie es bei der SÄZ heißt.

Aktuell und, äh, ja, irgendwie auch originell ist Arvays SÄZ-Artikel wirklich, nur mit der Qualität ist das so eine Sache. Es handelt sich im Wesentlichen um ein offenbar per Schlagwortsuche zusammengetragenes Sammelsurium von Bedenken zu modernen Impfstofftechniken aus völlig unterschiedlichen Quellen und Motivationen. Verstanden hat Arvay von dem, was er da angesammelt hat, ganz offensichtlich nicht viel. So schreibt er, die Verabreichung von DNA-Impfstoffen erfolge standardmäßig über stark beschleunigte Goldpartikel mit einer sogenannten Genkanone. Alle derzeit an Patienten getesteten DNA-Impfstoffe werden jedoch durch eine ganz normale Injektion verabreicht. Das ist auch kein Wunder, denn um eine gute Impfquote erreichen zu können, muss eine Impfung ja ohne aufwendige technische Geräte in einer Hausarztpraxis zu verabreichen sein. Zu RNA-Impfstoffen zitiert er (auch bei RT Deutsch) Überreaktionen in Tierversuchen zu anderen Coronaviren, hat aber offensichtlich nicht verstanden, dass gerade dieses Risiko bei traditionellen Lebend- und Totimpfungen viel größer wäre. Das geringere Risiko von Überreaktionen ist ja eben der Hauptgrund, warum in westlichen Ländern moderne Impfstoffe (z.B. die auf RNA- und DNA-Basis) favorisiert werden. Noch größer wäre ein solches Risiko von Überreaktionen natürlich, wenn exakt dieselben Antigene wie bei einer Totimpfung durch aktive Viren bei einer normalen Covid-19-Infektion eingebracht würden – und man darf nicht vergessen, dass ohne Impfstoff früher oder später (je nach sonstigen Maßnahmen) rund drei Viertel der Bevölkerung so infiziert würden. Bei Arvays haarsträubender Übertreibung in der SÄZ, eine Phase-III-Studie dauere „typischerweise 4–6 Jahre“ muss man sich die Frage stellen, ob es sich hier ebenfalls um Unkenntnis oder doch eher um bewusste Desinformation handelt.

Das tatsächliche Problem bei Arvay ist aber nicht das, was er in der SÄZ geschrieben hat, wo allzu offensichtlicher Unsinn der Redaktion dann wohl doch aufgefallen wäre. Auf RT Deutsch erklärt er, bei RNA-Impfstoffen würde „manipulierte genetische Information […] vom Körper inkludiert […] in die eigenen genetischen Abläufe“. In dieser Formulierung ist das keine direkte Lüge, je nachdem, wass man unter genetischen Abläufen verstehen will, aber es erweckt ganz gezielt den falschen Eindruck, als würde damit das menschliche Erbgut verändert. Eine nicht ganz so bizarre These, die sowohl in der SÄZ als auch bei RT Deutsch auftaucht, bezieht sich auf DNA-Impfstoffe (die sich durchweg noch in der Phase-I-Erprobung oder in der vorklinischen Phase befinden). Bei diesen, so Arvay, könnte DNA aus dem Impfstoff zufällig ins Erbgut einzelner Körperzellen integriert werden. Falls wiederum zufällig eine sehr ungünstige Stelle des Erbguts betroffen wäre, könnte das fremde DNA-Stück dort ein Gen zerstören, das das Wachstum der Zelle kontrolliert – das könnte dann zu Krebs führen. Auch hier erweckt er allerdings den Eindruck, es könne das Erbgut von mehr als einzelnen Zellen betroffen sein. Schon eine Schicht tiefer in der Schwurbelszene, bei Wolfgang Wodarg, wird daraus die schwachsinnige Behauptung, DNA- und RNA-Impfungen seien gentechnische Veränderungen des Menschen. Weiterhin kehrt Arvay unter den Teppich, dass selbst die von ihm in der SÄZ angegebene Quelle ausdrücklich erklärt, dass es für diesen angenommenen Effekt experimentell kaum Bestätigungen gibt. Was bei dieser Hypothese völlig untergeht, ist, dass die gleiche Integration fremder DNA in das Erbgut mit dem gleichen Tumorrisiko natürlich ebenso bei jedem beliebigen der ständig im Körper vorkommenden Bakterien oder Viren passieren könnte, insbesondere bei solchen, die wie der Impfstoff DNA in Plasmidringen enthalten. Dafür ist es nämlich völlig belanglos, welcher fremde DNA-Schnipsel da zufällig an einer verheerend ungünstigen Stelle im Erbgut einer einzelnen Zelle landet.

Kurz gesagt, Arvay benutzt im typischen Stil moderner Verschwörungsideologen ein Gemisch aus Halbwahrheiten, unzulässigen Verkürzungen und aus dem Zusammenhang gerissenen Details, um den Eindruck zu erwecken, es gäbe globale dunkle Machenschaften, hinter denen, wie er ausdrücklich betont, Bill Gates stecke. (Update 23.9.2020: Dagegen wehrt er sich inzwischen, spricht aber schon im nächsten Moment in Bezug auf Gates Engagement von „einer Seilschaft mit verschiedenen Pharmakonzernen“.) Dementsprechend ist es auch kein Wunder, dass seine Aussagen im Wesentlichen von den typischen Fake-News-Schleudern der Verschwörungsmythenszene verbreitet werden.

Anders als die meisten Verschwörungsideologen scheint er jedoch weniger politische als Marketingzwecke zu verfolgen, denn rein zufällig erscheint in wenigen Tagen sein neues Buch, dessen Untertitel die Arvay’sche Phantasiewelt wunderbar zusammenfasst: „Wie Umweltzerstörung die Corona-Pandemie auslöste und warum ökologische Medizin unsere Rettung ist“.

Update 29.8.21: Endlich fangen, wenigstens in Österreich, auch die Medien mal an, sich mit dem rechten Propagandanetzwerk um Clemens Arvay zu beschäftigen. Deutsche Medien, wie hier z.B. die Frankfurter Rundschau, fallen ja leider immer wieder auf ihn herein.