Eigentlich wollte ich zu Sucharit Bhakdi hier nichts schreiben. Anders als der kleinere Pseudoexperte der Schwurbelszene, Clemens Arvay, zu dem sich bis zu meinem Artikel hier so gut wie niemand von wissenschaftlich-kritischer Seite geäußert hatte (was sich inzwischen zum Glück ändert und sogar ein Stück weit auf Wikipedia niedergeschlagen hat), hat Bhakdi ja durchaus kritische Aufmerksamkeit bekommen. Anders gesagt, seine wirren Thesen zu Covid-19 sind schon seit März wieder und wieder und wieder und wieder auseinandergenommen worden. Eigentlich muss jetzt nicht noch ein unbedeutender Physikblogger über Bhakdi schreiben.

Dass ich es jetzt doch tue, hat zwei Gründe: Erstens geht es mir mal ganz grundsätzlich um die Frage, was jemanden eigentlich zum Experten macht, und zweitens bin ich einfach wütend. Ich bin wütend, weil Sucharit Bhakdi jetzt schon seit sechs Monaten wieder und wieder und wieder nachgewiesen wurde, dass er über Covid-19 einfach Blödsinn erzählt, aber etablierte Medien ihm wieder und wieder und wieder Sendezeit und Druckspalten einräumen und so den Eindruck erwecken, er sei für dieses Thema ein Experte mit einer abweichenden Meinung. Ganz aktuell tut das, leider nicht zum ersten Mal, die Fuldaer Zeitung – aber sie verweist dabei selbst auch auf ein aktuelles Interview bei der Deutschen Welle.

Die Deutsche Welle, immerhin DER internationale Informationskanal für die (und im Eigentum der) Bundesrepublik Deutschland, präsentiert Bhakdi in einem Musterbeispiel grotesker False Balance im Dialog mit dem Münchener Biometrieprofessor Ulrich Mansmann und bemerkt dazu, in Sachen Coronavirus seien die beiden „nicht immer einer Meinung“. Mansmann hat sich aus mir nicht erfindlichen Gründen schon mehrfach für ein solches „wissenschaftliches Streitgespräch“ mit Bhakdi hergegeben.

Was ist also nun von diesen Experten zu halten? Auf den ersten Blick tragen beide Professorentitel (auch wenn Bhakdis Zeit als aktiver Professor schon lange zurück liegt), und beide sind oder waren an Universitätskliniken tätig. Mansmann wird gerne als Epidemiologe vorgestellt, Bhakdi als Virologe und Epidemiologe, weil er mal Direktor des Mainzer Instituts für medizinische Mikrobiologie und Hygiene war. Für Tageszeitungsniveau scheint das auszureichen, um einen Experten auszuweisen, aber in der Praxis ist es leider nicht so einfach. Sehen wir uns die beiden Kontrahenten also näher an und vergleichen sie mal mit zwei anderen Professoren, die aktuell als Experten für Covid-19 durch die Medien geistern, nämlich den Virologen Christian Drosten und Hendrik Streeck.

Nachtrag 2.11.20: Inzwischen hat sich auf Scienceblogs Christian Meesters mit einer recht ähnlichen Herangehensweise neben (deutlich knapper als hier) Bhakdi auch noch den Rest der MWGFD, Bhakdis Verein von, äh, lupenreinen Demokraten, angesehen.

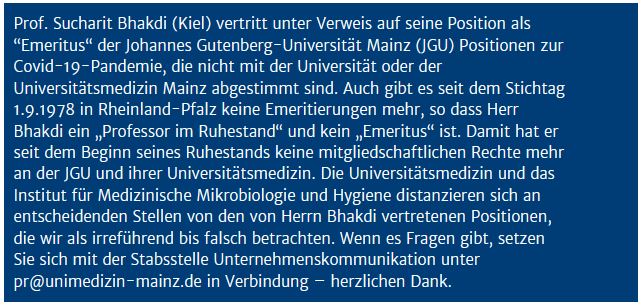

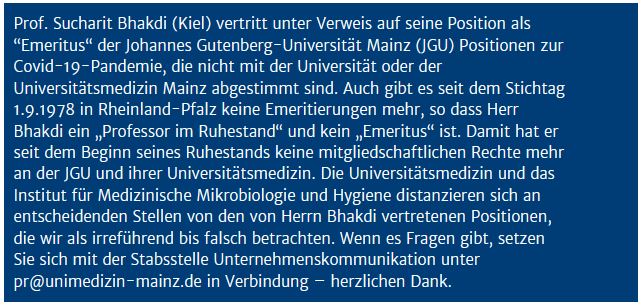

Nachtrag 6.11.20: Ende Oktober (und damit für meinen Geschmack ein gutes halbes Jahr zu spät, aber immerhin) hat jetzt auch die Uni Mainz gleich auf der Startseite seines früheren Instituts eine deutliche Distanzierung von Bhakdis pseudowissenschaftlichem Unsinn veröffentlicht. Ähnliches ist von der Uni Kiel, wo seine Frau und Koautorin noch beschäftigt ist, schon länger zu lesen, nur nicht ganz so auffällig platziert.

Das klingt auf den ersten Blick nicht allzu drastisch, und in der Tat könnte man sich das, vor allem wenn man selbst noch dort tätig ist und seinen eigenen Ruf von Bhakdis Machenschaften mit geschädigt sieht, noch deutlicher wünschen. Man muss es aber im Vergleich dazu sehen, wie zurückhaltend Hochschulen sonst die unwissenschaftlichen Aktivitäten ihrer aktuellen und ehemaligen Professoren kommentieren. Mein früheres Max-Planck-Institut hat zu den wüsten, physikalisch nicht begründeten und für das allgemeine Verständnis der Physik massiv schädlichen öffentlichen Spekulationen seines ex-Direktors Hans-Peter Dürr leider nie ein kritisches Wort verloren, sondern im Gegenteil noch einen lobhudelnden Nachruf veröffentlicht. Die Hochschule Furtwangen hat zur pseudowissenschaftlichen Skalarwellenlehre ihres Professors Konstantin Meyl lediglich öffentlich erklärt, er dürfe sie nicht in seinen Vorlesungen unterrichten. Von der Ostfalia-Hochschule warte ich bis heute auf eine Distanzierung von Professor Claus Turturs pseudowissenschaftlichen Nullpunktsenergie-Phantastereien und seinem Auftritt auf einer Veranstaltung, auf der öffentlich der Holocaust geleugnet wurde (ja, von jemand anders, aber klar vorher zu erwarten). Immerhin, in der aktuellen Version der Hochschulhomepage werden seine Thesen nicht mehr wiedergegeben, und die Verlinkung zum rechten Kopp-Verlag ist auch weg (er darf dazu aber noch auf die Wayback Machine verweisen).

Verglichen damit sind die Stellungnahmen der Unis in Kiel und Mainz zu Bhakdi so ziemlich die akademische Version von „Halt’s Maul, du Arschloch!“

Zur meiner nun folgenden grundsätzlichen Betrachtung von Bhakdi und seinem angeblichen Expertenstatus empfehle ich auch dieses Video von Mailab vom 7. Oktober, dass ich fahrlässigerweise erst jetzt angesehen habe.

Bei der Frage, was eigentlich ganz grundsätzlich ein Experte ist, nehme ich einfach mal mein eigenes früheres Arbeitsgebiet als Beispiel. In der heutigen Wissenschaft ist die Zeit von Universalgelehrten wie Goethe, Galilei oder Ibn Sina lange vorbei. Genau genommen war sie das schon zu Goethes Zeiten, was für diesen eine gewisse Tragik ausmacht, aber das ist eine andere Geschichte. Kurz gesagt, wie es Florian Aigner im Ferngespräch-Livestream zur Wissenschaftskommunikation so schön zusammengefasst hat: Fast jeder ist zu fast jedem Thema ein Laie. In meiner Zeit am CERN, dem Max-Planck-Institut für Physik und dem Brookhaven National Laboratory Ende der 1990er Jahre habe ich mich mit der Entwicklung sogenannter Spurendriftkammern und der Analyse von Messfehlern darin beschäftigt. Das ist ein relativ alter Typ von Teilchendetektor, der heute vor allem noch in der Analyse von Kollisionen schwerer Atomkerne verwendet wird. Für die vielleicht zwei oder drei Handvoll Menschen weltweit, die sich damals für diese Messfehler interessiert haben, dürfte ich als einer der Experten gegolten haben. Jedenfalls haben Professoren aus dem Ausland mich nach meinen Ergebnissen und Einschätzungen gefragt. Mit den Leuten, die das 20 Jahre später, zum Beispiel am ALICE-Experiment am CERN tun, könnte ich vermutlich immer noch ein halbwegs kompetentes Gespräch führen, und vielleicht würde mir sogar noch der eine oder andere nützliche Tip einfallen, der irgendwie nie aufgeschrieben wurde und in Vergessenheit geraten ist. Die Experten dafür sind aber die Leute, die das jetzt tun, nicht mehr ich. In der sonstigen Erforschung von Kollisionen schwerer Atomkerne verstehe ich noch ganz gut, was die Forscher tun. Früher war ich da noch deutlich näher dran, aber selbst damals hätte ich jemandem, der dazu einen anderen Detektortyp verwendet oder gar die theoretischen Modelle entwickelt, nicht sagen können, ob seine Arbeit gut oder schlecht und seine Ergebnisse richtig oder falsch sind. Das war noch in meinem engeren Fachgebiet, aber schon so weit weg, dass ich deren Ergebnisse einfach akzeptieren musste. Ich konnte sie aber verstehen, wiedergeben und auch Dritten erklären. Wenn ich heute zum Beispiel im Quantenquark-Buch andere Themen aus der Physik, etwa zum Higgs-Boson oder zur extrem ungeschickt so bezeichneten „Quantenteleportation“ erkläre, dann muss ich mich dazu vorher in das Thema einlesen. Ich kann mich dazu aber schneller und in der Regel besser einlesen, als jemand, der nicht Physik studiert hat. Würde ich mich jedoch hinstellen und erklären, das am CERN nachgewiesene Higgs-Boson sei gar kein Higgs-Boson, dann würde es in Genf – völlig zu Recht – nicht mal jemand für nötig halten, mir zu widersprechen. Ich kann den wissenschaftlichen Konsens in anderen Bereichen meines Fachs zwar erklären, aber mir fehlt jede Grundlage, um ihn kompetent in Frage zu stellen. Wenn ich die Physik verlasse und mir die Medizin ansehe, was ich in letzter Zeit pandemiebedingt ja öfter mal tue, dann bin ich noch ein Stück weiter weg und kann mich in der Regel noch ein wenig langsamer und schlechter einlesen, als das jemand könnte, der in der Medizin, dort aber in einem anderen Bereich tätig ist. Ich kann es aber immer noch besser als jemand, der nie wissenschaftlich gearbeitet hat oder aus einem Feld kommt, das ganz andere Methoden verwendet als die in der Hinsicht recht ähnlichen Felder Medizin und Naturwissenschaften, also zum Beispiel ein Philosoph, ein Historiker oder ein Jurist.

Was aber jeder können sollte, der wissenschaftliches Arbeiten gelernt hat, ist, mit überschaubarem Aufwand festzustellen, ob jemand für ein Thema Experte ist oder nicht. Dafür gibt es nämlich sehr einfache Methoden. Wer in einem Feld forscht, veröffentlicht seine Ergebnisse in wissenschaftlichen Fachzeitschriften. Ohne das geht es nicht, denn ohne Veröffentlichung gibt es keine gegenseitige Überprüfung. Also: Keine Veröffentlichung – keine Wissenschaft. Alle Veröffentlichungen in den seriösen Fachzeitschriften eines Gebiets lassen sich in entsprechenden Datenbanken recherchieren. Die wichtigste derartige Datenbank für die Medizin ist Pubmed, betrieben von der National Library of Medicine. Wenn jemand in der Medizin zu einem Thema wissenschaftliche Leistungen vollbracht hat, dann findet man das in Pubmed. Dort kann jeder recherchieren. Man hat nicht unbedingt kostenlosen oder auch nur erschwinglichen Zugang zu den Artikeln, aber man findet, wo die Artikel stehen, und dabei steht eine Zusammenfassung.

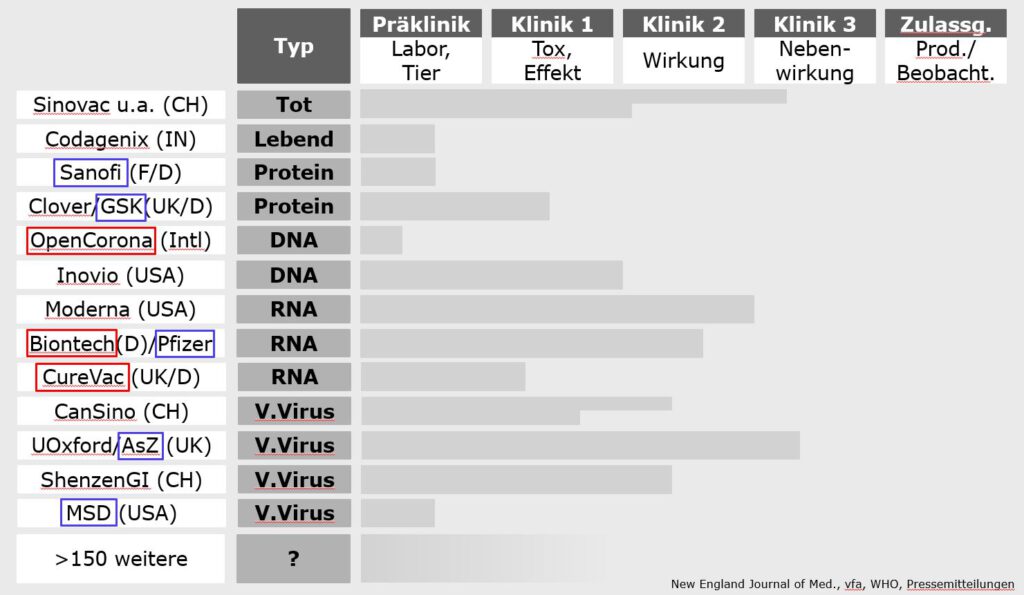

Was erwarten wir nun also von einem Experten für Covid-19? So eine Krankheit ist selbst wieder extrem komplex, und es arbeiten Spezialisten aus unterschiedlichen Teilbereichen der Medizin, Pharmazie und Mikrobiologie daran. Wenn es um Ansteckung, Ausbreitung und Gefährlichkeit geht, können einem aber am ehesten Experten aus zwei Themenbereichen weiterhelfen: Entweder sie forschen am Virus selbst (das tun überwiegend Virologen) oder an seiner Ausbreitung (das tun eher Epidemiologen). Einen Experten für das SARS-CoV-2-Virus würde man daran erkennen, dass er genau dazu wissenschaftliche Artikel veröffentlicht hat, idealerweise auch schon vorher zu anderen Coronaviren wie SARS, MERS, den Erkältungsviren oder tierischen Coronaviren. Ein Experte für die Epidemiologie von Covid-19 sollte eben darüber veröffentlicht haben, und vielleicht schon vorher zur Ausbreitung anderer Atemwegsinfekte wie Grippe oder grippalen Infekten.

Wenn Sucharit Bhakdi jemals zu irgendwelchen Coronaviren geforscht hat, dann sollte sich das in Pubmed sehr leicht finden lassen, schon über die sehr einfache Suchabfrage „Sucharit Bhakdi Coronavirus“. Sie liefert 0 Treffer. „Ulrich Mansmann Coronavirus“ liefert ebenfalls 0 Treffer – das ist aber nicht sonderlich überraschend. Ulrich Mansmann ist kein Virologe, sondern Mathematiker und in der Medizin ein absoluter Methodenspezialist für komplexe mathematische Modelle. Dementsprechend ziehen sich seine Publikationen durch alle möglichen Teilbereiche der Medizin, mit Schwerpunkten bei Krebs und Malaria. Wenn man die schwierig zu erfassende epidemiologische Situation rund um Covid im und nach dem Lockdown im Frühjahr mathematisch modellieren will, wäre Mansmann sicherlich jemand, der zumindest beratend hilfreich dabei sein könnte. Vielleicht tut er das auch gerade, vielleicht hat er es getan, aber nicht in hinreichend zentraler Rolle, um als einer der Autoren aufzutauchen. Wieviel Mansmann selbst zu SARS-CoV-2 oder Covid-19 geforscht hat, ist aber auch gar nicht wichtig, denn was er in den Streitgesprächen tut, ist, er erklärt den wissenschaftlichen Konsens. Man muss selbst kein Experte zu einem Thema sein, wenn man einfach nur das erklärt, was die Experten sagen. Wenn man hingegen die Experten alle für dumm oder korrupt ausgibt, sollte man schon belegen können, dass man selbst entsprechend Ahnung hat.

Machen wir den gleichen Test mal mit unseren Vergleichs-Virologen. Die Suchanfrage „Hendrik Streeck Coronavirus“ ergibt fünf Treffer, alle aus dem Jahr 2020. Das ist kein Wunder, denn Streeck gilt als Experte für HIV und hat bekanntermaßen erst im Zuge des Ausbruchs von Covid-19 angefangen, zu SARS-CoV-2 zu forschen. Die Suchanfrage „Christian Drosten Coronavirus“ ergibt 149 Treffer von 2020 bis zurück ins Jahr 2003. Das ist (neben seiner hervorragenden Wissenschaftskommunikation und seiner angenehmen Eigenheit, dabei sich selbst gegenüber der Sache zurückzunehmen) genau der Grund, weshalb so viele Leute Wert auf Drostens Einschätzungen zu Covid-19 legen: Es gibt wahrscheinlich niemanden in Deutschland, vielleicht niemanden in Europa, der mehr zu menschlichen Coronaviren geforscht hat als Christian Drosten.

Wenn Sucharit Bhakdi also nicht zu Coronaviren geforscht hat, dann vielleicht zur Epidemiologie von viralen Atemwegserkrankungen? Er wird ja gerne auch als Epidemiologe verkauft. Die Suchanfrage „Sucharit Bhakdi respiratory“ ergibt vier Treffer – keiner davon hat irgendetwas mit Viruserkrankungen zu tun, schon gar nicht mit Grippe oder Ähnlichem. Was ist denn aber dann mit dem angeblichen Virologen Sucharit Bhakdi? Zu irgendwelchen Viren wird er ja wohl geforscht haben? Die Suchanfrage „Sucharit Bhakdi virus“ ist einigermaßen ernüchternd: Sie liefert genau drei Treffer. Einer der Artikel beschreibt eine tatsächliche eigene Studie, in der es um den Schaden geht, den Dengueviren (die mit Coronaviren nichts zu tun haben) an Blutgefäßwänden anrichten können. Bhakdi ist einer von 20 Autoren und war vermutlich an der Studie beteiligt, weil er lange zu Blutgefäßwänden geforscht hat. Der zweite Treffer ist ein Konferenzvortrag, in dem Bhakdi über einen Sonderforschungsbereich berichtet hat, dessen Sprecher er war und in dem er selbst über (Überraschung!) Blutgefäßwände geforscht hat, während andere Forscher darin auch an Viren, vor allem Hepatitisviren geforscht haben. Der dritte Treffer ist aus dem Jahr 2009, eine Spekulation über mögliche Risiken für (eben!) Blutgefäßwände durch Grippeimpfstoffe mit Wirkverstärkern. Hier werden also tatsächlich Grippeviren erwähnt, es geht aber inhaltlich nicht um die Grippe, schon gar nicht um das Virus, sondern nur um die Impfverstärker. Nachdem solche Wirkverstärker seit Jahren bei einer Vielzahl von Impfstoffen eingesetzt und die Effekte in großen Studien überwacht werden, kann man mit Sicherheit sagen, dass die von Bhakdi damals herbeispekulierten Nebenwirkungen nicht eingetreten sind. Solche Spekulationen sind ein normaler Teil eines wissenschaftlichen Prozesses. Dass Bhakdi Spekulationen über Schäden durch Grippeimpfungen damals gerade während der (unvorhersehbar zum Glück relativ harmlos verlaufenen) Schweinegrippepandemie veröffentlicht hat, lässt aber bei ihm ein Muster erahnen, das sich möglicherweise heute wieder zeigt.

Das war es mit Sucharit Bhakdis Arbeiten, die mit Viren zu tun haben. Tatsächlich geforscht hat er zunächst vor allem zu Bakterien, später hat er eine Außenseitermeinung zur Entstehung von Atherosklerose (also der Verhärtung von Blutgefäßwänden) vertreten. Darauf, beziehungsweise auf einen Teilaspekt davon, sogenannte ADAM-Proteasen, beziehen sich auch alle Artikel, die in Pubmed noch mit seinem Namen auftauchten, nachdem er vor knapp 10 Jahren das Rentenalter erreicht hat. Auch Außenseitermeinungen sind als Beiträge zur Wissenschaft wertvoll – wenngleich in der großen Mehrzahl der Fälle falsch.

Auch darauf kommt es aber nicht an. Entscheidend ist, Bhakdi widerspricht zu Covid-19 dem wissenschaftlichen Konsens der Experten, und das ist in diesem Fall eben keine wissenschaftliche Außenseitermeinung, denn dazu müsste Bhakdi selbst Experte in diesem Feld sein. Es gibt aber in Bhakdis kompletter Publikationsliste nicht den geringsten Hinweis darauf, dass er von Coronaviren oder auch nur von irgendwelchen anderen Atemwegsviren oder von Viren überhaupt (abgesehen vielleicht von der Wirkung von Dengueviren auf die Gefäßwände) irgendeine fachliche Ahnung hat. Er äußert sich schlicht zu Dingen, von denen er selbst nichts versteht, versteigt sich aber dazu, den Fachleuten zu widersprechen, wo er bestenfalls ihre Ergebnisse erklären sollte.

Und dennoch wird er von der Deutschen Welle und vielen anderen Medien als Experte (mit einer ach so interessanten Außenseitermeinung) ausgegeben.

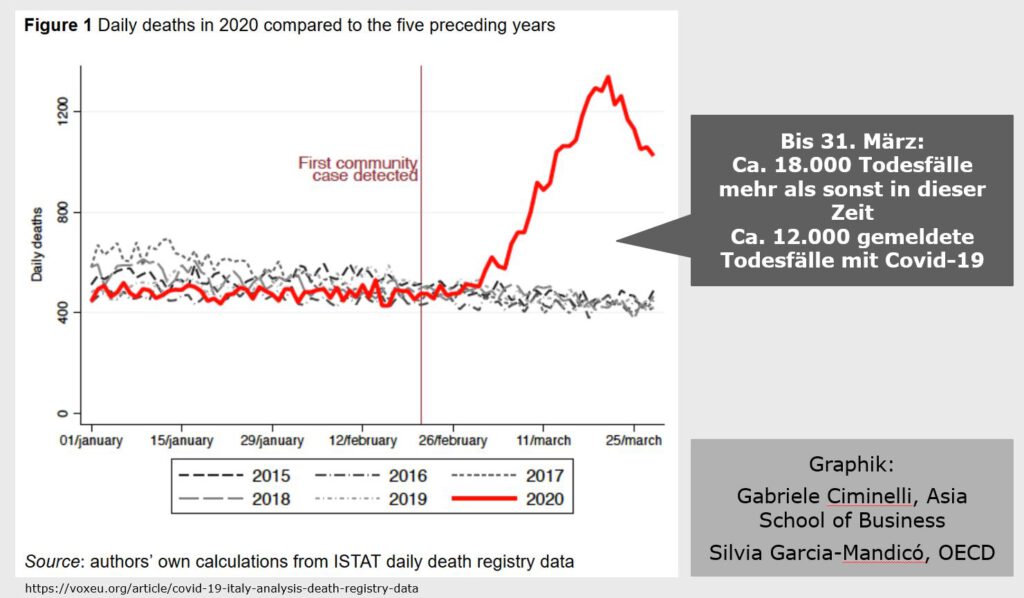

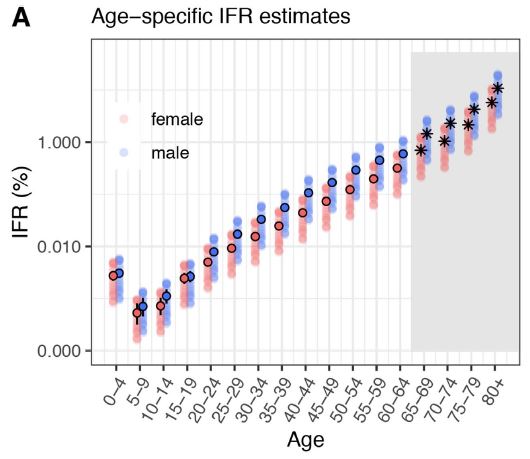

Sucharit Bhakdi ist aber nicht bloß kein Experte – es ist viel schlimmer. Was mich wirklich wütend macht, sind die Aussagen von Bhakdi in seinem Interview mit der Deutschen Welle, das am 3.10. veröffentlicht wurde. Es kann sich auch nicht um eine zu diesem Zeitpunkt schon lange zurückliegende Aufzeichnung handeln, denn Bhakdi spricht darin von März und April als „vor sechs Monaten“. Im nächsten Satz kommt aber die entscheidende Aussage von Bhakdis Behauptungen: „Jetzt aber, nachdem die Epidemie definitiv vorbei ist…“ Am 3. Oktober 2020 erklärte Sucharit Bahkdi, die Covid-19-Epidemie sei definitiv vorbei. Das hat nichts mit der Frage zu tun, ob jemand ein Experte für Coronaviren oder für Epidemiologie von Atemwegserkrankungen ist. Es hat schlicht damit zu tun, dass es nichts mit der Realität zu tun hat. Zu diesem Zeitpunkt gab es in Deutschland pro Tag schon wieder über 2000 nachgewiesene Neuinfektionen, mehr als fünfmal so viele wie beim Minimum im Sommer. Weltweit gab es jeden Tag mehr als 300 000 nachgewiesene Neuinfektionen und innerhalb eines Monats 165 000 Tote, bei denen Covid-19 nachgewiesen war. Wieviel höher die Zahl der tatsächlichen Todesopfer in Ländern wie dem Iran, Indien oder Teilen Afrikas gewesen sein muss, kann man nur raten. Selbst in den USA mit ihrem gut ausgebauten Gesundheitssystem lag die Übersterblichkeit während der gesamten Pandemie fast 50% über den gemeldeten Covid-19-Toten. In Italien wurden im März „nur“ 12 000 Covid-19-Tote registriert – es starben aber zwischen 25 000 und 30 000 Menschen mehr als sonst im gleichen Zeitraum. In Deutschland war zum Zeitpunkt von Bhakdis „definitiv vorbei“ auch die Zahl der Covid-19-Patienten in Intensivstationen schon wieder deutlich am Steigen, und in Spanien näherte sich das Gesundheitssystem bereits wieder der Überlastung. Alle diese Informationen waren für jeden verfügbar und problemlos nachzurecherchieren.

Ich weiß nicht, was Sucharit Bhakdi Anfang Oktober zu seiner Aussage bewegt hat, die Epidemie sei „definitiv vorbei“ – ich kann ihm ja nicht in den Kopf sehen. Mir fallen für eine Person, die zu diesem Zeitpunkt öffentlich eine solche Aussage gemacht hat, aber eigentlich nur drei denkbare Erklärungen ein: Pure Dummheit, bewusste Lüge oder ein durch Verschwörungsglauben ausgelöster Realitätsverlust, der eigentlich nur mit dem von Xavier Naidoo oder Attila Hildmann vergleichbar ist.

Update 29.1.2021:

Guten Flug, Herr Bhakdi; lassen Sie sich gerne Zeit mit dem Zurückkommen. Und wenn Sie Deutschland totalitär finden, dann können Sie sich in Thailand ja mal kritisch über den König äußern.